Allgemeine Informationen rund um die Kurse von L. Neumeier

- Dozent/in: Laura Neumeier

Weitere Kurse

Künstliche Intelligenz (KI) verändert die IT-Sicherheitslandschaft grundlegend – sowohl auf Angreifer- als auch auf Verteidigerseite. Besonders Große Sprachmodelle (LLMs) wie ChatGPT spielen dabei eine entscheidende Rolle als Enabler für neue Angriffsmethoden, aber auch für leistungsfähige Abwehrmechanismen. Diese Vorlesung vermittelt die Grundlagen der KI, erklärt die Mechanismen moderner Cyberangriffe und zeigt, wie LLMs für sowohl offensive als auch defensive Zwecke genutzt werden können.

Inhalt der Vorlesung im Überblick

Kapitel 1: Grundlagen der KI und Großer Sprachmodelle

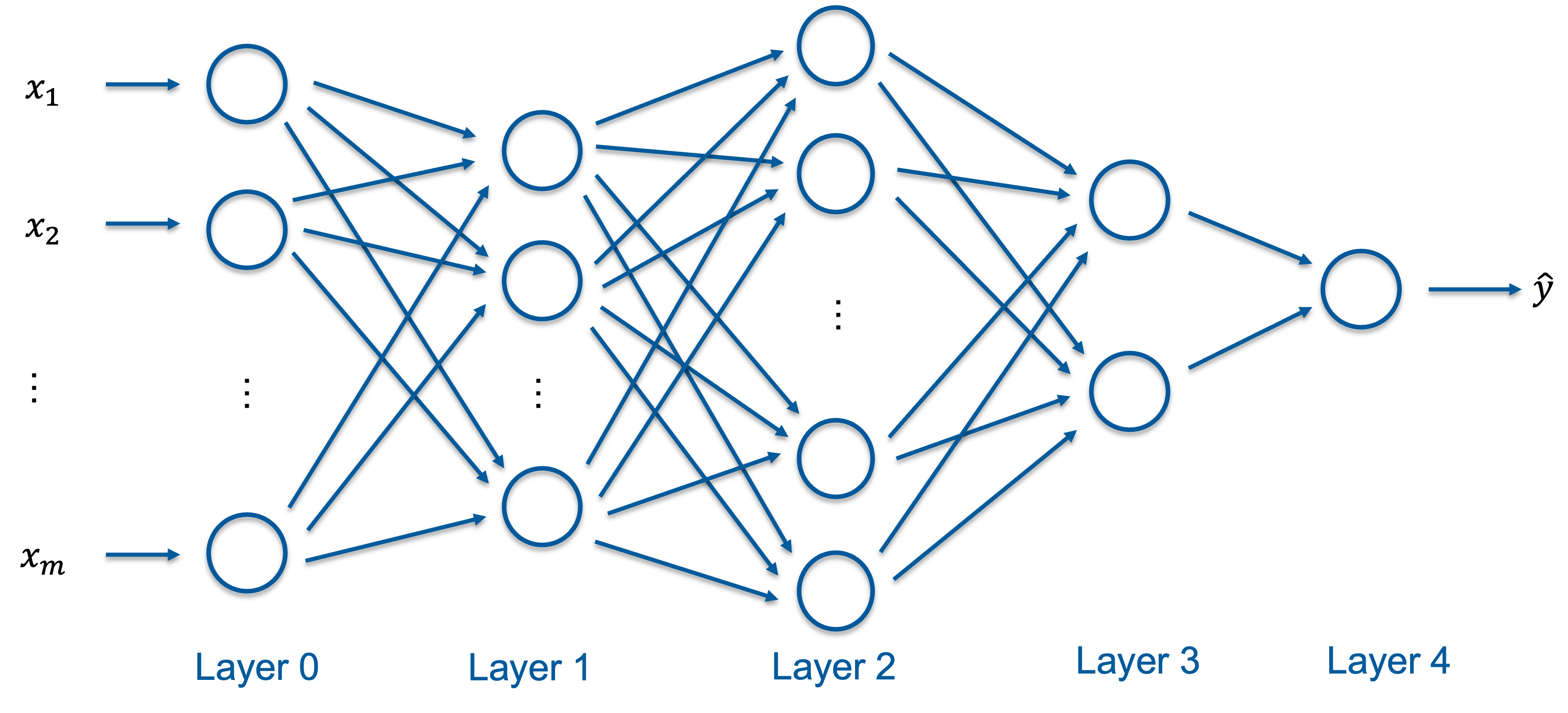

Zunächst werden die grundlegenden Konzepte des Maschinellen Lernens behandelt, darunter lineare und logistische Regression, neuronale Netze und die Funktionsweise Großer Sprachmodelle. Ihr Potenzial und ihre Grenzen im Kontext der IT-Sicherheit stehen dabei im Fokus.

Kapitel 2: Grundlagen der IT-Sicherheit

Hier geht es um die zentralen Schutzziele der Informationssicherheit, Netzwerkkommunikation, Passwörter, Authentifizierung sowie die Phasen eines Hacking-Angriffs (Cyber Kill Chain). Dieses Wissen bildet die Basis für das Verständnis moderner Angriffstechniken.

Kapitel 3: Angriffe unter Verwendung eines Großen Sprachmodells

KI-gestützte Angriffe eröffnen neue Möglichkeiten für Passwort-Cracking, OSINT-Recherche, Phishing, Port-Scans sowie Schwachstellen-Exploits (SQL-Injection, XSS, Buffer Overflows). LLMs ermöglichen Angreifern eine schnellere und gezieltere Durchführung dieser Angriffe.

Kapitel 4: Abwehr von Angriffen unter Verwendung eines Großen Sprachmodells

Gegenmaßnahmen umfassen die automatisierte Code-Überprüfung, die Erkennung von Angriffen in Log-Dateien und der Einsatz von KI-gestützten Honeypots, die Angreifer täuschen und identifizieren können.

Kapitel 5: Angriffe auf Große Sprachmodelle

Auch LLMs selbst sind verwundbar. In diesem Kapitel werden Prompt Injection, Model Poisoning, Supply-Chain-Angriffe und weitere Schwachstellen untersucht, um Sicherheitsrisiken beim Einsatz von KI besser zu verstehen.

KI als Enabler in der IT-Sicherheit

Große Sprachmodelle haben das Potenzial, sowohl Cyberangriffe zu automatisieren und zu verbessern als auch effektive Verteidigungsstrategien zu entwickeln. Das Gleichgewicht zwischen Offensive und Defensive ist ein zentraler Punkt der Vorlesung: Wer die Angriffsseite versteht, kann bessere Schutzmechanismen aufbauen. Die Studierenden sollen dazu befähigt werden, KI nicht nur als Werkzeug, sondern auch als kritischen Sicherheitsfaktor zu begreifen und sicher einzusetzen.

- Dozent/in: Andreas Arnold

- Mitdozierende/r: Laura Neumeier

Hier finden Sie die Materialien der Vorlesung Maschinelles Lernen 1 für KI

- Dozent/in: Sören Gröttrup

- Mitdozierende/r: Laura Neumeier

Hier finden Sie die Materialien der Vorlesung und des Praktikums zum Modul Maschinelles Lernen 2 für KI

- Dozent/in: Michael Botsch

- Dozent/in: Sören Gröttrup

- Mitdozierende/r: Laura Neumeier

Hier finden Sie die Materialien der Vorlesung und des Praktikums zum Modul Maschinelles Lernen 3 für KI

- Dozent/in: Sören Gröttrup

- Mitdozierende/r: Kai Hartung

- Mitdozierende/r: Laura Neumeier

- Dozent/in: Sören Gröttrup

- Mitdozierende/r: Laura Neumeier